Sam Altman trong 24 giờ: Bộ trưởng Quốc phòng nói "Không" hai lần, nhưng chỉ một lần là nghiêm túc

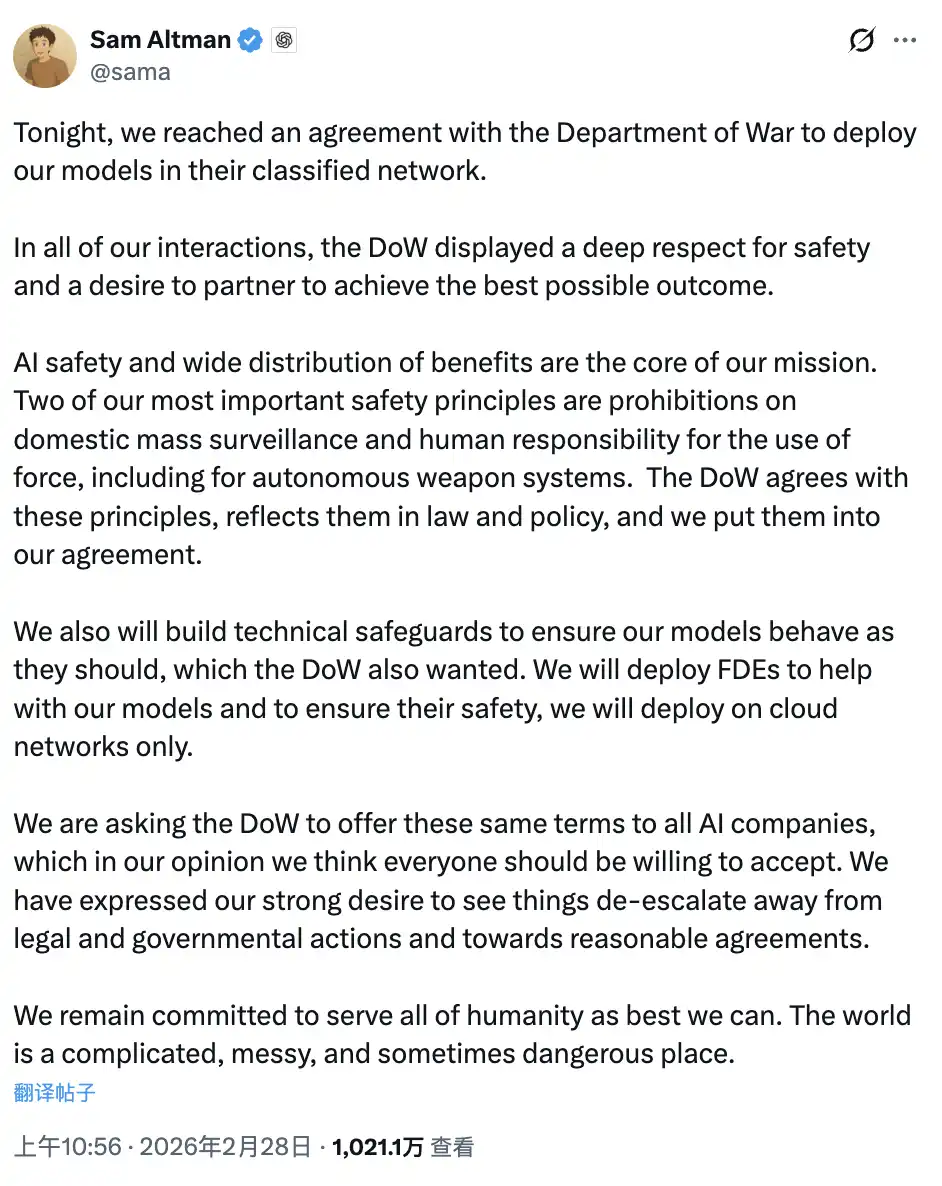

Vào sáng ngày 28 tháng 2 theo giờ Bắc Kinh, Sam Altman đã đăng một tweet: "Tối nay, chúng tôi đã đạt được thỏa thuận với Bộ Quốc phòng Mỹ để triển khai mô hình của chúng tôi vào mạng lưới bí mật của họ."

Một cú nhấp thời gian khoảng mười hai giờ trở lại, đến tối ngày 27 tháng 2 theo giờ Bắc Kinh. Cũng là anh ấy, ngồi trước ống kính chương trình Squawk Box của CNBC, với giọng điệu bình tĩnh nói: "Với Anthropic, mặc dù chúng tôi có rất nhiều điểm bất đồng, tôi tin tưởng cơ bản vào công ty này. Tôi nghĩ họ thực sự quan trọng về an ninh." Anh ấy còn nói: "Tôi không nghĩ Bộ Quốc phòng nên đe dọa các công ty này bằng Đạo luật Sản xuất Quốc phòng."

Chưa đến mười hai giờ, cùng một cánh miệng, hai đoạn văn. Điều gì đã xảy ra giữa đó, đáng để từ từ làm sáng tỏ.

Hai điều khoản tương tự, hai kết quả khác nhau

Hãy đặt hai nội dung chính của hai hợp đồng cạnh nhau.

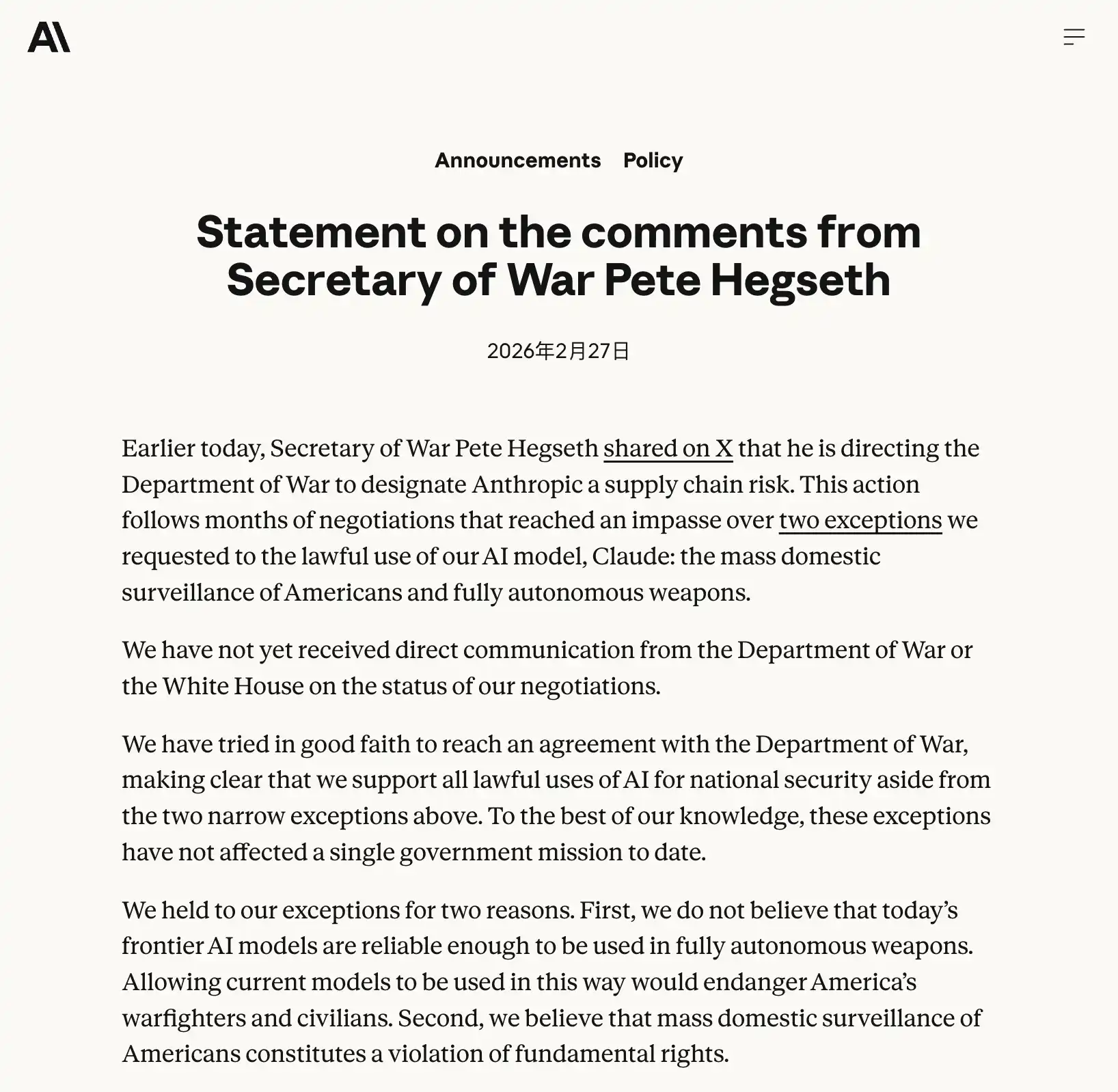

Yêu cầu của Anthropic: Claude không được sử dụng cho giám sát quy mô lớn của công dân Mỹ, không được sử dụng cho hệ thống vũ khí tự động không có sự can thiệp của con người.

Khi Altman công bố thỏa thuận trong tweet, anh ấy trích dẫn hai nguyên tắc giống nhau: "Chúng tôi đã tin tưởng từ lâu rằng Trí tuệ Nhân tạo không nên được sử dụng cho giám sát quy mô lớn hoặc vũ khí tự động gây chết người, con người nên luôn có mặt trong quyết định tự động có rủi ro cao." Anh ấy còn viết: "Bộ Quốc phòng đã đồng ý với những nguyên tắc này, đã phản ánh chúng trong pháp lý và chính sách, chúng tôi đã viết chúng vào hợp đồng."

Văn bản gần như hoàn toàn giống nhau.

Một công ty bị cấm, được liệt vào "Rủi ro chuỗi cung ứng", bị Tổng thống Trump chửi là "công ty thức tỉnh cánh tả cực hướng trái". Một công ty khác nhận được hợp đồng, tiến vào mạng lưới bí mật của Bộ Quốc phòng, Sam Altman trong tweet sử dụng từ "đạt được thỏa thuận" - bình tĩnh, thương mại, như là một giao dịch B2B thông thường đã hoàn tất giao nhận.

Đây là câu hỏi mà toàn bộ bài viết muốn trả lời: những điều khoản tương tự, tại sao kết quả hoàn toàn khác biệt?

Đáp án không nằm trong các điều khoản, mà nằm trong logic đứng sau các điều khoản đó.

Có một sự thật nền chính cần phải nói rõ trước: Anthropic là công ty duy nhất trong bốn công ty này (ba công ty còn lại là OpenAI, Google, xAI) được phép kết nối Trí tuệ Nhân tạo vào mạng lưới bí mật của Bộ Quốc phòng. Hợp đồng ban đầu của OpenAI, chỉ bao gồm các tình huống văn phòng hàng ngày không bí mật. Cuộc đàm phán lần này, về cơ bản, là OpenAI muốn tiến vào mạng lưới bí mật, và điều kiện vào cửa mà Bộ Quốc phòng đề xuất chính là điều khoản "tất cả mục đích hợp pháp" gây tranh cãi đó. Anthropic đã ở trong đó, nhưng Bộ Quốc phòng yêu cầu gỡ bỏ cánh cửa an toàn mà họ đã đặt ra khi nhập vào.

Bộ Tư lệnh không quan tâm tới việc viết gì, mà quan trọng là ai nói lên điều đó

Để hiểu vấn đề này, trước hết bạn cần hiểu Dario Amodei từ Anthropic đã nói gì trong lá thư mở đầu đó.

Anh ấy viết: "Anthropic hiểu rằng quyết định quân sự thuộc về Bộ Tư lệnh chứ không phải các công ty tư nhân. Chúng tôi chưa bao giờ phản đối cho một hành động quân sự cụ thể và cũng chưa bao giờ cố gắng tạm thời hạn chế việc sử dụng công nghệ của chúng tôi."

Sau đó anh ấy chuyển sang một hướng khác: "Nhưng trong một số trường hợp rất ít, chúng tôi tin rằng Trí tuệ Nhân tạo có thể gây thiệt hại thay vì bảo vệ các giá trị dân chủ. Mối đe dọa không thay đổi quan điểm của chúng tôi: chúng tôi có lòng tự trọng và không thể chấp nhận yêu cầu của họ."

Câu này dịch sang ngôn ngữ hợp đồng có ý nghĩa gì? Anthropic yêu cầu rằng nguyên tắc phải được viết cứng trong điều khoản hợp đồng, tạo thành ràng buộc cứng rắn. Nếu bên kia vi phạm, họ có quyền từ chối tiếp tục cung cấp dịch vụ.

Bộ Tư lệnh nghe thấy điều gì? Một công ty tư nhân, nói với quân đội của chính phủ rằng: trong một số trường hợp, tôi có thể không thực hiện mệnh lệnh của bạn, ranh giới do tôi định đạt.

Điều này là không chấp nhận đối với bất kỳ lực lượng quân đội nào. Không phải vì họ thực sự muốn thực hiện giám sát quy mô lớn, mà vì việc "quyền lực thuộc về ai" chính là vấn đề nhạy cảm nhất trong hệ thống chỉ huy quân sự. Người đứng đầu mua sắm quân sự Jerry McGinn nói một cách trực tiếp: Nhà thầu quân sự thường không có quyền nói với Bộ Tư lệnh cách sản phẩm của họ có thể được sử dụng, không thể được sử dụng, "nếu không mỗi hợp đồng đều phải thảo luận về kịch bản sử dụng cụ thể, điều này không thực tế".

OpenAI đã đưa ra câu trả lời hoàn toàn khác.

Altman trong bản ghi nhớ đã thông báo với nhân viên rằng, OpenAI sẽ đề xuất cho Bộ Tư lệnh xây dựng "safety stack" riêng, một hệ thống bảo vệ đa tầng bao gồm kiểm soát công nghệ, khung chính sách và kiểm duyệt của con người, được nhúng giữa mô hình AI và việc sử dụng thực tế. OpenAI đồng thời cho biết, họ có thể phân chốt các nhà nghiên cứu có bằng phép an ninh vào trong mạng lưới bí mật, theo dõi liên tục hành vi của AI; các mô hình chỉ được triển khai trên đám mây, không đi vào các hệ thống xung quanh như máy bay không người lái.

Chuyển ngữ ra là: Bạn đến kiểm tra, bạn đến giám sát, bạn nhìn thấy mọi thứ xảy ra. Nếu có vấn đề, chúng tôi sẽ chịu trách nhiệm cùng, không phải bạn đến tìm giải thích từ tôi.

"Quyền lực được viết cứng, tôi thực hiện" và "tôi nhúng, bạn giám sát", đó là hai mối quan hệ quyền lực hoàn toàn khác nhau, và Bộ Tư lệnh chỉ chấp nhận cái thứ hai.

OpenAI Tốt Nhất trong Việc Mà Bộ Quốc Phòng Hoa Kỳ Mong Muốn

Đây là một lời mỉa mai gây khó chịu cần phải được làm sáng tỏ.

OpenAI đã thực hành "minh bạch về công nghệ" và "giám sát liên tục" mà họ cam kết với Bộ Quốc Phòng trên người dùng của chính họ.

Vào tháng 8 năm 2025, trong một bài đăng blog chính thức về cuộc khủng hoảng sức khỏe tâm lý của người dùng, OpenAI đã tiết lộ một cơ chế giám sát mới: khi hệ thống detect ra người dùng "dự định gây hại cho người khác," cuộc trò chuyện sẽ được chuyển vào một kênh riêng, được xử lý bởi một nhóm kiểm duyệt công tác được đào tạo, người này được ủy quyền để báo cáo tình huống cho cơ quan chức năng. Điều này được OpenAI công bố một cách tự nguyện, nhưng được giấu giếm giữa các dòng văn bản tĩnh tâm lý sức khỏe.

Vào tháng 2 năm 2026, ngay trước lúc ký hợp đồng lần này, OpenAI triển khai hệ thống quảng cáo và cập nhật chính sách bảo mật, rõ ràng một điều: người dùng miễn phí và trả phí cơ bản khi sử dụng ChatGPT, hệ thống sẽ tiến hành "phân tích ngữ cảnh trong cuộc trò chuyện," hiển thị quảng cáo tương quan dựa trên chủ đề trò chuyện. Ví dụ, nếu bạn đang thảo luận về công thức nấu ăn, bạn có thể thấy quảng cáo dịch vụ giao đồ ăn. OpenAI nhấn mạnh nội dung cuộc trò chuyện chính nó sẽ không được chuyển cho các nhà quảng cáo, nhưng phân tích hành vi xảy ra trực tiếp. Quảng cáo bắt đầu được thử nghiệm vào ngày 9 tháng 2.

Vào tháng 11 năm 2025, nhà cung cấp dịch vụ phân tích bên thứ ba của OpenAI, Mixpanel, đã bị tấn công mạng, rò rỉ một phần tên, email, vị trí địa lý xấp xỉ, hệ điều hành và trình duyệt của người dùng API. OpenAI sau đó đã chấm dứt hợp tác với Mixpanel, hiện tại đã có vụ kiện đang diễn ra. Sự cố chủ yếu ảnh hưởng đến người dùng phát triển API, và người dùng thông thường của ChatGPT bị ảnh hưởng là những người đã gửi yêu cầu hỗ trợ qua trung tâm trợ giúp của nền tảng.

Đó chính là công ty cam kết với Bộ Quốc Phòng "minh bạch về công nghệ, giám sát liên tục, để bạn thấy mọi sự việc xảy ra."

Điều họ giỏi nhất, chính là làm cho người khác nhìn vào, bởi vì họ đã quen với cách xử lý người dùng của chính họ như vậy.

Anthropic tin rằng các quy tắc có thể kiểm soát người dùng, OpenAI tin rằng việc nhúng con người của chính mình vào là hiệu quả hơn bất kỳ điều khoản nào. Người đầu tiên theo đuổi lý do tuân theo lý tưởng, người thứ hai theo đuổi lý do ảnh hưởng theo lý do thực tế. Bộ Quốc Phòng đã chọn cái thứ hai, vì cái thứ hai đối với họ quen thuộc hơn, và cũng dễ kiểm soát hơn.

Trong Vài Giờ Cuối Cùng, Đã Xảy Ra Điều Gì?

Quay trở lại vào lúc 5:01 ngày 27 tháng 2 theo giờ Đông Hoa Kỳ, vào rạng sáng ngày 28 tháng 2 theo giờ Bắc Kinh.

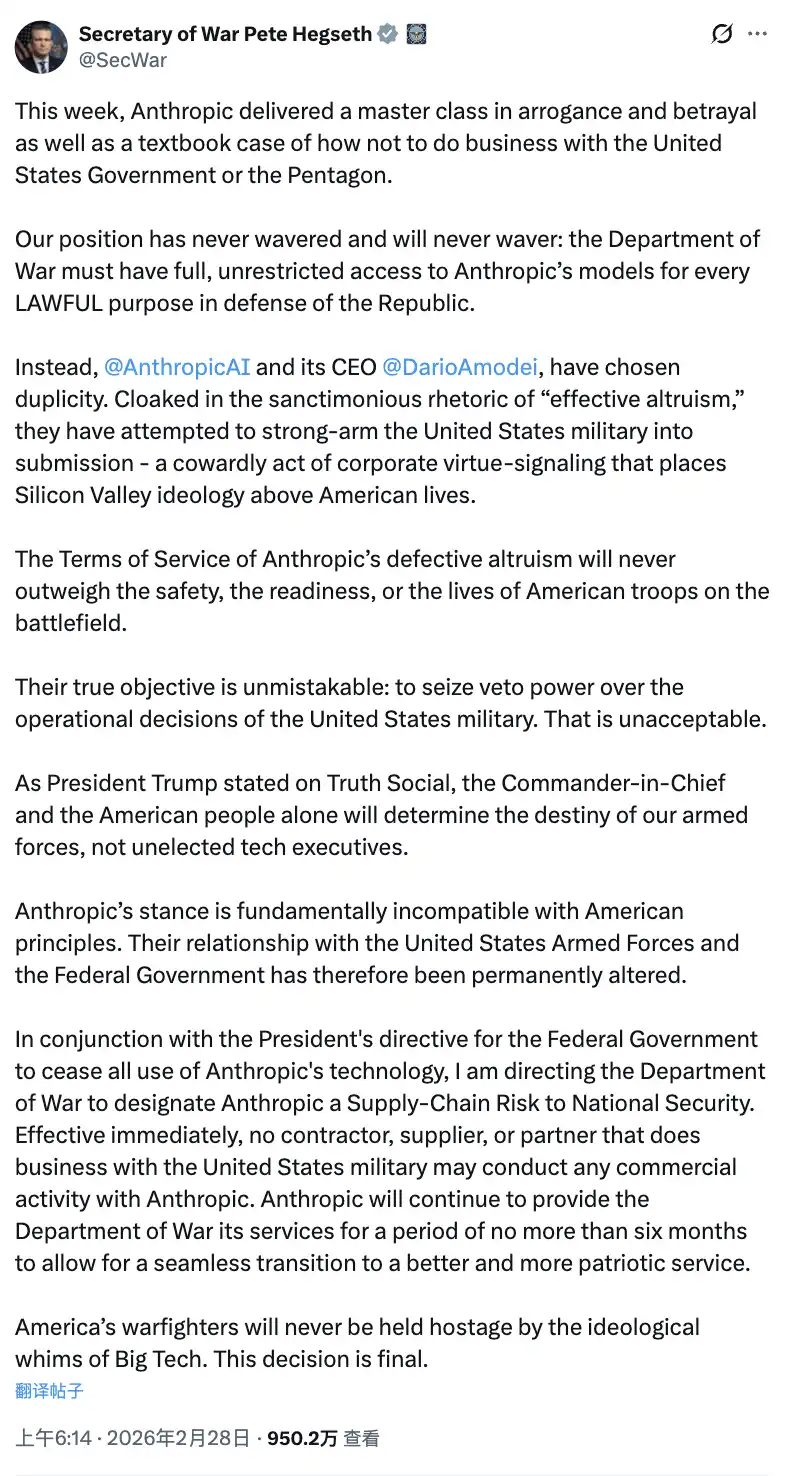

Thời hạn cuối cùng của Anthropic đã đến. Dario không thoả hiệp. Trump thông báo cấm truy cập Anthropic trên Truth Social, Hegseth đăng bài trên X xếp Anthropic vào danh sách "Rủi ro chuỗi cung ứng", Anthropic tuyên bố sẽ phản kháng bằng con đường pháp lý.

Trong tuyên bố của Hegseth có một câu đáng chú ý: "Thái độ của Anthropic hoàn toàn không tương thích với nguyên lý Mỹ." Sau đó, trong cùng một tuyên bố, ông cho biết Anthropic có thể tiếp tục cung cấp dịch vụ cho Bộ Quốc phòng "không quá sáu tháng, để có một sự chuyển giao mượt mà." Nghĩa là, họ mới đánh giá một công ty là một rủi ro cho an ninh quốc gia, nhưng vẫn tiếp tục sử dụng sản phẩm của công ty đó. Mâu thuẫn logic này, không ai giải thích một cách trực tiếp.

Vài giờ sau, Altman đăng tweet đó.

Trở lại phát biểu của ông tại cuộc họp toàn công ty vào sáng cùng ngày: ông nói rằng hy vọng OpenAI có thể "giúp làm dịu tình hình" và tìm ra một giải pháp có thể "đưa ra một khung pháp lý cho toàn bộ ngành". Điều này không phải là giọng điệu của một người đang chờ đợi một cách biến động.

Điều này không phải là lần đầu tiên Silicon Valley thấy cách làm như vậy.

Năm 2023, Hội đồng Quản trị phi lợi nhuận của OpenAI đã sa thải Altman với lý do "thiếu sự trung thực", cáo buộc là ông tiến quá nhanh và giao tiếp nội bộ có vấn đề. Năm ngày sau, Altman trở lại với thư ủng hộ tập thể từ nhân viên, hội đồng quản trị tan rã. Sau đó, ông điều hành quá trình tái cấu trúc công ty từ một tổ chức phi lợi nhuận sang một tổ chức cùng nắm quyền lực, nhiệm vụ phi lợi nhuận ban đầu của công ty được tích hợp vào một khung pháp lý mới.

Lần này, điều đó được gọi là "tìm ra một khung pháp lý chung".

Dario đã mất điều gì?

Jerry McGinn, Giám đốc Trung tâm Nghiên cứu Cơ sở Công nghiệp của Trung tâm Nghiên cứu Chiến lược và Quốc tế Hoa Kỳ, đã đưa ra một đánh giá điều độ về sự việc này: "Điều này là một cú PR tuyệt vời đối với Anthropic, và họ thực sự không cần khoản 200 triệu USD đó."

Đánh giá này là chính xác về mặt tài chính. Anthropic có doanh thu cả năm 2025 là 140 tỷ USD, vốn hóa 380 tỷ USD, cổ đông lớn nhất Amazon sẽ không xem xét lại logic đầu tư chỉ vì một lệnh cấm từ chính phủ. Con đường pháp lý có thể đưa đến cơ hội đổi vận. Giá trị niêm yết công khai lần đầu có khả năng không bị ảnh hưởng mạnh mẽ; câu chuyện "từ chối áp lực chính phủ, đề cao nguyên tắc an ninh" này, có lẽ không có bất kỳ ngân sách PR nào có thể mua được kết quả tương đương.

Nhưng có một điều, Dario đã thua cuộc.

Việc sử dụng thực tiễn của trí tuệ nhân tạo trong lĩnh vực quân sự sẽ được chuẩn bị bởi OpenAI tại Pentagon, chứ không phải Anthropic. Đó là bộ công cụ an toàn được nhúng vào mạng cá nhân, những nhà nghiên cứu OpenAI có giấy phép an ninh, hệ thống theo dõi hành vi trí tuệ nhân tạo. Chúng sẽ trở thành tiêu chuẩn ngành trong vài năm tới.

Anthropic giữ vững lập trường vì nguyên tắc, nhưng đã mất ghế ngồi trong quá trình lập ra quy định.

Và người ngồi vào ghế đó, chính là người đã hoàn thành quá trình từ "ủng hộ" sang "ký kết" trong thời gian chưa đầy mười hai giờ.

Điều mỉa mai nhất là: công ty chăm chút nhất đến an toàn trí tuệ nhân tạo đã bị đuổi khỏi nơi cần phải chăm chút nhất đến an toàn trí tuệ nhân tạo.

Công ty kế vị, chỉ hai tuần trước mới triển khai cơ chế đưa chủ đề trò chuyện của người dùng vào hệ thống quảng cáo, ba tháng trước đã trải qua vụ rò rỉ dữ liệu từ bên thứ ba, và cách đây không lâu đã tiết lộ một hệ thống quét cuộc trò chuyện có thể chuyển thông tin người dùng tới cơ quan chức năng một cách bí mật.

Ở Thung lũng Silicon, màn diễn của Altman trong thời gian chưa đầy mười hai giờ đó có một cái tên. Không gọi là phản bội, mà gọi là timing.

Chào mừng bạn tham gia cộng đồng chính thức của BlockBeats:

Nhóm Telegram đăng ký: https://t.me/theblockbeats

Nhóm Telegram thảo luận: https://t.me/BlockBeats_App

Tài khoản Twitter chính thức: https://twitter.com/BlockBeatsAsia