Cuộc Cá Cược IPO của Anthropic: Trong lúc không nên từ chối nhất, họ lại quyết định từ chối

Hãy tưởng tượng một tình huống như sau.

Bạn nợ tiền điện nước ba tháng, tháng trước bạn phải vào bệnh viện khám bệnh, bạn mỗi năm đều trung thực nộp thuế. Những việc này dường như không liên quan gì đến nhau.

Nhưng trong một hệ thống Trí tuệ Nhân tạo nào đó, ba thông tin này được tổng hợp lại với nhau, tạo ra một chấm đỏ trên bản đồ. Chấm đỏ đó, đại diện cho vị trí của bạn, và một hướng dẫn thực thi pháp lý dành cho bạn.

Điều này không phải là viễn tưởng. Đầu năm 2026, Cục Di trú Liên bang Mỹ đã tiến hành một chiến dịch bắt giữ trên quy mô lớn tại Minneapolis, với hệ thống logic ấy là cơ sở. Hệ thống Trí tuệ Nhân tạo liên quan đến đến từ một công ty dữ liệu có tên Palantir, nó đã tích hợp hồ sơ y tế của người nhập cư, hóa đơn tiền điện nước, thông tin nộp thuế vào thuật toán, lạnh lùng đánh dấu từng mục tiêu bị truy nã.

Trí tuệ Nhân tạo đang được vũ trang. Đó không phải là tương lai, đó là hiện tại.

Vấn đề không phải là nó có xảy ra hay không, mà là ai có quyền quyết định nó có thể làm gì, không thể làm gì.

Vào ngày 27 tháng 2 năm 2026, vấn đề này đã nhận được một câu trả lời đầy bất an.

Ngày đó, một công ty Trí tuệ Nhân tạo có tên Anthropic — cũng chính là nhà phát triển sản phẩm Trò chuyện AI Claude, đối thủ cạnh tranh cùng cấp độ với ChatGPT, đã bị chính phủ Mỹ chính thức cấm. Lý do cấm là vì nó từ chối để AI của mình được sử dụng để giám sát công dân Mỹ, cũng như tự quyết định tấn công vào mục tiêu.

Nó đã được đánh giá là "Rủi ro An ninh quốc gia" vì nó nói "Không thể sử dụng như vậy".

Một công ty sắp IPO, cái gì cần nhất

Trước khi trả lời câu hỏi "Tại sao Anthropic không thể thoả hiệp", đầu tiên phải hiểu rõ vị trí hiện tại của nó.

Anthropic hiện là một trong những công ty trí tuệ nhân tạo được định giá cao nhất trên toàn cầu, với ước tính 3800 tỷ USD, doanh thu cả năm 2025 đạt 140 tỷ USD. Nhà đầu tư lớn nhất của nó là Amazon, sở hữu tỷ lệ cổ phần cao hơn bất kỳ cổ đông nào khác. Mô hình AI của nó, Claude, là một trong những sản phẩm AI cho doanh nghiệp tăng trưởng mua hàng nhanh nhất hiện tại.

Theo bất kỳ tiêu chuẩn nào, đây đều là một công ty sẵn sàng IPO. Thực tế, trong năm nay, Anthropic thực sự đang chuẩn bị cho IPO, tức là lần đầu tiên công bố niêm yết công khai, đưa cổ phiếu của mình đến tay công chúng.

Một công ty sắp IPO, cái gì cần nhất? Câu trả lời gần như không cần suy nghĩ: ổn định, dự đoán được, không gặp rắc rối với quản lý. Bất kỳ sự kiện tiêu cực nào, đều có thể ảnh hưởng đến sự tin tưởng của các nhà đầu tư vào công ty, từ đó làm suy yếu giá định giá IPO.

Sau đó, mọi thứ đã phát triển theo hướng hoàn toàn ngược lại.

Vào tháng 7 năm 2025, Bộ Tư lệnh Quây 5 cùng lúc đã kí kết hợp đồng trị giá tối đa 200 triệu đô la với Anthropic, OpenAI (nhà phát triển ChatGPT), Google và xAI của Musk, nhằm mục tiêu tích hợp trí tuệ nhân tạo tiên tiến nhất vào hệ thống quân sự Mỹ. Đây là lần mua sắm của chính phủ với quy mô lớn nhất trong lịch sử trí tuệ nhân tạo.

Đáng chú ý, hợp đồng của Anthropic có một điểm mà ba công ty còn lại không có. Trong hợp đồng rõ ràng ghi hai hạn chế sử dụng: Claude không được sử dụng cho việc giám sát quy mô lớn trên công dân Mỹ và không được sử dụng cho hệ thống vũ khí tự động không có sự can thiệp của con người.

OpenAI, Google, xAI, đều đồng ý rằng quân đội có thể sử dụng trí tuệ nhân tạo cho mọi mục đích hợp pháp mà không có bất kỳ hạn chế bổ sung nào. Chỉ có Anthropic, trong hợp đồng đã đưa ra hai đường kẻ màu đỏ.

Hai đường kẻ màu đỏ này sau này đã trở thành điểm khởi đầu của mọi rắc rối.

Đe dọa Cuối cùng

Vào tháng 2 năm 2026, Bộ Tư lệnh Quân đội quyết định đẩy mạnh áp lực đối với Anthropic.

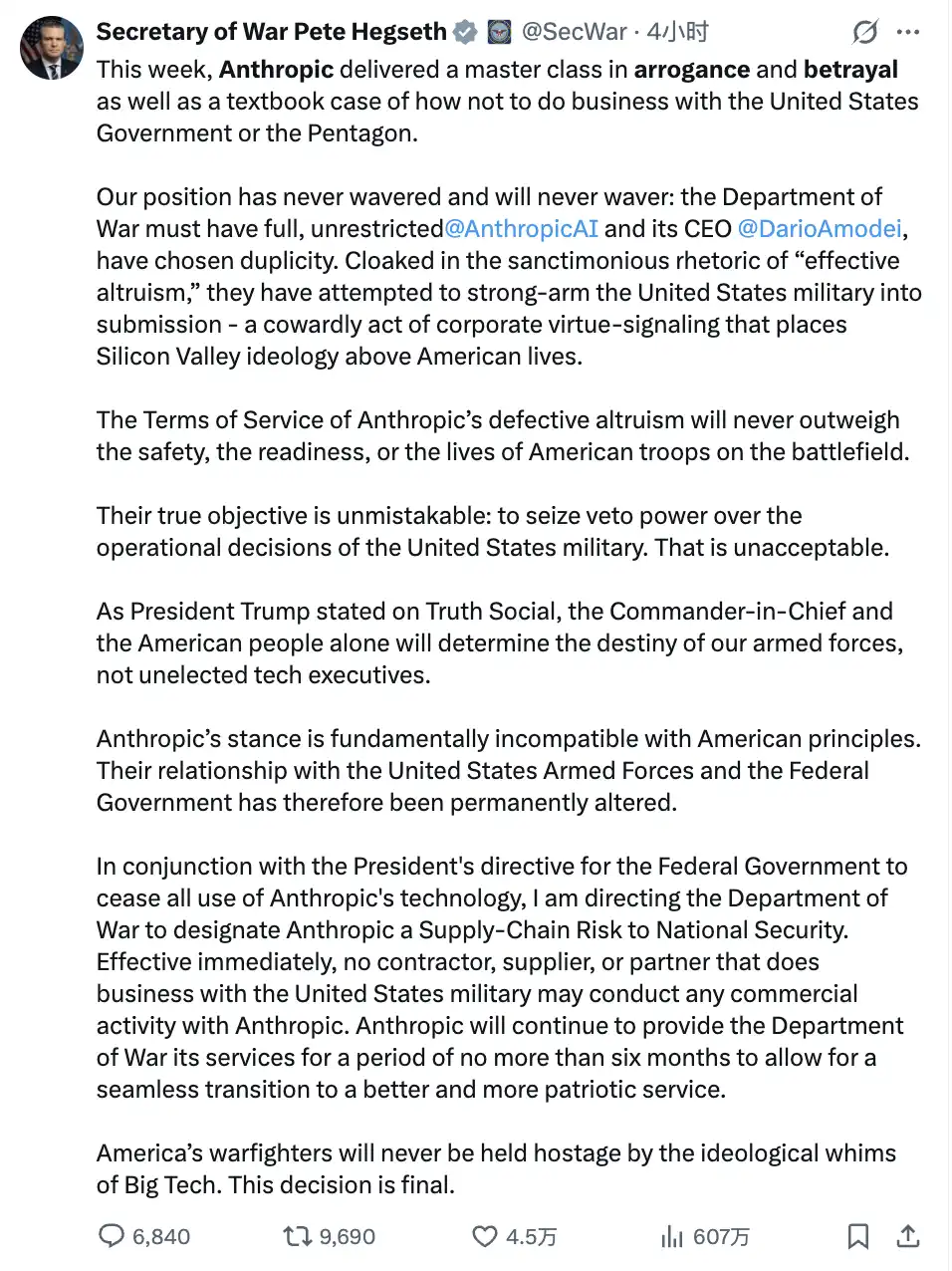

Thứ trưởng Bộ Quốc phòng Pete Hegseth đã mạnh dạn gửi thông điệp đe dọa cuối cùng đến Giám đốc điều hành của Anthropic, Dario Amodei: Loại bỏ các hạn chế sử dụng khỏi hợp đồng, cho phép Claude được sử dụng cho mọi mục đích hợp pháp. Nếu không, Bộ Tư lệnh Quân đội sẽ hủy bỏ hợp đồng và xem xét Anthropic là "Mối nguy lực lượng cung ứng". Thời hạn đến chiều ngày 27 tháng 2 theo giờ địa phương.

Phản ứng của Dario là: Không.

Trong tuyên bố công khai, ông viết: "Chúng tôi hiểu, quyết định quân sự hoàn toàn thuộc về chính phủ chứ không phải doanh nghiệp tư nhân. Nhưng trong rất ít trường hợp, chúng tôi tin rằng trí tuệ nhân tạo có thể gây hại thay vì bảo vệ các giá trị dân chủ. Chúng tôi không lương tâm, không chấp nhận yêu cầu của họ."

Người đứng đầu công nghệ của Bộ Tư lệnh Quân đội, Emil Michael, ngay sau đó đã đăng bài trên mạng xã hội gọi Dario là kẻ lừa đảo, "mắc chứng Thượng đế", "cố gắng kiểm soát quân đội Mỹ một cách cá nhân, không ngần ngại đặt nguy cơ an ninh quốc gia lên trên tất cả".

Sau đó, Trump bản thân đã xuống tay. Ông đã viết trên nền tảng truyền thông xã hội của mình Truth Social rằng Anthropic là "công ty thức tỉnh cánh tả trái đất", "đã phạm một sai lầm thảm họa" và ra lệnh: tất cả cơ quan liên bang phải ngay lập tức ngừng sử dụng tất cả sản phẩm của Anthropic, hoàn tất chuyển đổi trong vòng 6 tháng.

Bộ Tư lệnh Hợp chúng ngay lập tức đã xếp Anthropic vào danh mục "Rủi ro chuỗi cung ứng".

Ảnh hưởng này trước đây chỉ được sử dụng để đánh dấu các công ty liên quan đến đối thủ nước ngoài như Trung Quốc. Đã dùng cho Huawei, đã dùng cho SMIC. Bây giờ đến lượt một công ty trí tuệ nhân tạo Mỹ có trụ sở tại San Francisco, định giá 380 tỷ đô la.

2 Tỷ Đô la chỉ là chuyện nhỏ, rắc rối thực sự là ở đây

Phản ứng đầu tiên của nhiều người là: Mất hợp đồng chính phủ trị giá 2 tỷ đô la chỉ là con số không đáng kể đối với doanh thu hàng năm 14 tỷ đô la của Anthropic.

Điều này đúng, nhưng nhìn nhầm chỗ.

Sức mạnh thực sự đến từ chính "rủi ro chuỗi cung ứng" này. Ý nghĩa của nó là: Bất kỳ công ty nào hợp tác với quân đội Mỹ đều phải chứng minh rằng họ không từng tiếp xúc với Anthropic. Điều này không phải là áp lực đạo đức mềm dẻo, mà là yêu cầu tuân thủ cứng rắn.

Theo dõi những ảnh hưởng từ điểm này, phạm vi bắt đầu trở nên không lạc quan.

Dịch vụ Đám mây Amazon là cơ sở hạ tầng chính của Claude, đồng thời cũng là nhà cung cấp dịch vụ Đám mây lớn nhất của chính phủ Mỹ, hai bên có mối liên kết sâu rộng. Công ty phân tích dữ liệu Palantir, khi cung cấp dịch vụ cho quân đội và cơ quan tình báo Mỹ, đã tích hợp với Claude. Công ty công nghệ quốc phòng Anduril, trong các dự án liên quan đến Bộ Tư lệnh Hợp chúng, đã sử dụng Claude để xử lý dữ liệu.

Người dùng này bây giờ phải đưa ra quyết định: Tiếp tục sử dụng Claude, chịu áp lực hợp tác với một công ty "rủi ro chuỗi cung ứng"; hay thay thế Claude, thay thế công cụ đã được nhúng sâu vào quy trình làm việc.

Cả hai lựa chọn đều là thiệt hại đối với Anthropic. Đây mới chính là rủi ro thực sự cần quản lý, xa hơn nhiều so với số tiền hợp đồng 2 tỷ đô la đó đáng lo ngại.

Và tất cả những rắc rối này, đều xảy ra trước khi công ty niêm yết công khai.

Tại sao vẫn từ chối

Vấn đề trở nên thú vị.

Một công ty đang lên kế hoạch niêm yết công khai, đúng vào thời điểm mà họ ít cần nhất rắc rối, đối mặt với áp lực từ chính phủ mà chọn phản công. Điều này là lỗi đánh giá kinh doanh, hay là một cú đánh đúng đã được tính toán trước?

Đặt hai lựa chọn cạnh nhau, logic sẽ trở nên rõ ràng hơn.

Nếu nhượng bộ, hợp đồng được giữ lại, quan hệ với chính phủ không bị ảnh hưởng, rắc rối hiện tại biến mất. Nhưng câu chuyện nhãn hiệu cốt lõi nhất của Anthropic trong ba năm qua - "Công ty trí tuệ nhân tạo có trách nhiệm nhất", "An toàn là ưu tiên hàng đầu", sẽ xuất hiện vết nứt tại thời điểm này.

Rủi ro lớn hơn không ở đằng trước. Khi Claude thực sự được sử dụng cho giám sát quy mô lớn hoặc quyết định về vũ khí tự động, một khi xảy ra bất kỳ tai nạn nào, thiệt hại không phải là một hợp đồng, mà là toàn bộ logic định giá công ty. Sự trả giá mà nhà đầu tư ban đầu trả cho câu chuyện "Trí Tuệ Nhân Tạo Trách Nhiệm" sẽ biến mất qua một đêm.

Nếu từ chối, mất 2 tỷ đô la, gắn nhãn nguy cơ chuỗi cung ứng, thị trường chính phủ gần như đóng cửa. Nhưng câu chuyện thương hiệu "An Toàn Là Quan Trọng Nhất" đã nhận được lời khen công khai đắt giá nhất từ trước đến nay. Không có ngân sách quảng cáo nào có thể mua được hiệu ứng này, bị chính phủ cấm vì từ chối cho phép Trí Tuệ Nhân Tạo giám sát công dân trong nước.

Dario đã nói một câu trong tuyên bố, đáng xem xét riêng: "Giá trị định giá và doanh thu của chúng tôi, sau tuyên bố này chỉ tăng không giảm."

Câu nói này có phải là lời nói công chúng hay là đánh giá thương mại? Có thể cả hai, nhưng chúng không mâu thuẫn.

Đây là một ví dụ phản diện có thể tham khảo. Palantir chính là công ty dữ liệu đã được đề cập trước đó— đã đi theo con đường hoàn toàn ngược lại. Họ chặt chẽ hợp tác với mọi nhu cầu của chính phủ, từ theo dõi di cư, phân tích tình báo, đến xác định mục tiêu quân sự. Do đó, trong vòng gần hai mươi năm, họ đã bị trục xuất khỏi vòng tài trợ của giới vốn lớn quan trọng về trách nhiệm xã hội, không thể huy động vốn lâu dài.

Sau đó vào năm 2024, khi câu chuyện công nghiệp quân sự Trí Tuệ Nhân Tạo trở thành cốt truyện chính thống, giá cổ phiếu tăng 150% trong một năm, vốn hóa thị trường vượt qua 4000 tỷ đô la.

Hai con đường, hai số phận, đều có lý do riêng. Palantir đã đổi lấy sự kiên nhẫn hai mươi năm để có ngày hôm nay. Anthropic đặt cược vào một logic định giá khác—trong thời điểm cạnh tranh đồng nhất của công ty Trí Tuệ Nhân Tạo trở nên gay gắt, "Trí Tuệ Nhân Tạo an toàn nhất" không chỉ là một quan điểm đạo đức, mà còn là một pháo đài thương mại thực sự tồn tại.

Đặt cược nào lớn hơn, hiện tại vẫn chưa rõ. Nhưng rõ ràng Anthropic tin rằng, chi phí của sự nhượng bộ cao hơn so với việc từ chối.

Đặt cược của Dario, liệu có thể chiến thắng?

Câu trả lời của bài toán này phụ thuộc vào một số biến chưa thể xác định.

Đầu tiên, là phản ứng thực sự của khách hàng doanh nghiệp. Amazon, Palantir và Anduril, sẽ có cắt Claude tự nguyện vì nhãn hiệu rủi ro chuỗi cung ứng, hay chọn giữ nguyên, đợi tình thế thay đổi? Hiện tại, các công ty này vẫn chưa đưa ra tuyên bố công khai. Nếu họ chọn chờ đợi, lỗ thực tế của Anthropic sẽ thậm chí chỉ là 2 tỷ đô la từ hợp đồng chính phủ.

Thứ hai, là độ khó thực tế của việc thay thế bởi chính phủ. Một bộ phận trong Pentagon đã thừa nhận rằng Claude hiện tại là một trong những mô hình AI mạnh nhất có sẵn, với Grok của Musk vẫn còn kém cỏi ở mức độ công nghệ. Thay thế này có nghĩa là giảm hiệu suất sử dụng. Ai sẽ chịu trách nhiệm cho chi phí này?

Cuối cùng, là hiệu ứng dây chuyền không ngờ đến của vấn đề này. Ngay trong ngày Anthropic bị cấm, CEO của OpenAI - công ty phát triển ChatGPT, Sam Altman, công khai đứng ra bày tỏ: OpenAI và Anthropic "chia sẻ cùng một giới hạn đỏ", về ranh giới sử dụng AI quân sự, hai công ty đã thống nhất quan điểm.

Nói cách khác — nếu chính phủ muốn tìm một phương án thay thế sẵn lòng tuân thủ hoàn toàn mà không có bất kỳ hạn chế nào, sự lựa chọn có ít hơn nhiều so với tưởng tượng.

Quá trình quân sự hóa AI sẽ không bị chậm trễ vì vấn đề này. Grok của Musk đã tiến vào mạng lưới bí mật của Pentagon, các hợp đồng quân sự của các công ty AI khác không hề giảm bớt, hệ thống vũ khí hỗ trợ bởi AI vẫn đang tiếp tục được cập nhật.

Lựa chọn của Anthropic không thay đổi hướng đi này. Điều thay đổi chỉ là vị trí của chính nó trong hướng đi này.

Nhưng có một điều chắc chắn: Đây là lần đầu tiên trong lịch sử ngành công nghiệp AI, một công ty phổ biến đã công khai đứng vững trước áp lực từ chính phủ theo nguyên tắc rõ ràng — thậm chí khi cuối cùng phải trả giá bằng việc bị cấm. Dù kết quả cuộc đấu cược này như thế nào, tiền lệ này đã tồn tại.

Bài toán cuối cùng, dành cho độc giả: Một công ty được định giá 380 tỷ đô la, vì hai nguyên tắc viết trong hợp đồng, đã từ bỏ toàn bộ thị trường chính phủ, và sau đó bị xem là một rủi ro cho an ninh quốc gia.

Trong thời đại quân sự hóa AI ngày nay, việc này được tính toán như thế nào — phụ thuộc vào bạn nghĩ rằng điều đắt giá nhất trong tương lai là gì.

Chào mừng bạn tham gia cộng đồng chính thức của BlockBeats:

Nhóm Telegram đăng ký: https://t.me/theblockbeats

Nhóm Telegram thảo luận: https://t.me/BlockBeats_App

Tài khoản Twitter chính thức: https://twitter.com/BlockBeatsAsia