Token hệ sinh thái Bittensor tăng giá 5 lần trong tháng 3, điều gì đã xảy ra sau câu nói của Huang Renxun?

Tiêu đề ban đầu: "Hwang In-hyeon bị đề cập? SN3 Tăng giá 5 lần trong tháng, đã làm gì?"

Tác giả ban đầu: KarenZ, Foresight News

Ngày 20 tháng 3 năm 2026, đã có một cuộc trò chuyện không thường thấy trên podcast đầu tư toàn diện All-In.

Ông lớn trong lĩnh vực đầu tư Chamath Palihapitiya đã chuyển sự chú ý đến CEO của NVIDIA Hwang In-hyeon, nói rằng có một dự án trên Bittensor đã "hoàn thành một thành tựu công nghệ khá điên rồ", sử dụng sức mạnh tính toán phân tán để huấn luyện một mô hình ngôn ngữ lớn trên Internet, quá trình hoàn toàn phi tâm trung, không có trung tâm dữ liệu tâm trung nào tham gia.

Hwang In-hyeon không trốn tránh. Anh so sánh việc này với "phiên bản hiện đại của Folding@home", dự án phân tán đã cho phép người dùng thông thường đóng góp sức mạnh tính toán không sử dụng để chống lại vấn đề gập protein trong những năm 2000.

Trước đó 4 ngày, vào ngày 16 tháng 3, Jack Clark, người sáng lập liên minh Anthropic, trong bản báo cáo tiến bộ nghiên cứu trí tuệ nhân tạo, cũng dành nhiều chỗ cho và trích dẫn sự đột phá này: Mạng phụ sinh thái Bittensor Templar (SN3) đã hoàn thành quá trình huấn luyện phân tán của mô hình lớn với 720 tỷ tham số (Covenant 72B), hiệu suất của mô hình tương đương với LLaMA-2 mà Meta đã phát hành vào năm 2023.

Jack Clark đã đặt tên cho chương này là "Thách thức Kinh tế chính trị AI thông qua Huấn luyện Phân tán", và trong phân tích, ông nhấn mạnh rằng đây là một công nghệ đáng theo dõi - ông có thể tưởng tượng một tương lai: AI tại thiết bị sẽ sử dụng mô hình được sản xuất từ huấn luyện phi tâm trung một cách rộng rãi, trong khi AI trên đám mây sẽ tiếp tục chạy các mô hình lớn chuyên biệt.

Phản ứng của thị trường có phần chậm trễ nhưng rất mạnh mẽ: SN3 đã tăng hơn 440% trong vòng một tháng qua, tăng hơn 340% trong hai tuần qua, với vốn hóa thị trường đạt 1,3 tỷ USD. Cuộc bùng nổ câu chuyện của mạng phụ trực tiếp dẫn đến áp lực mua TAO. Do đó, TAO đã tăng nhanh chóng, tạm thời đạt mức 377 USD, tăng gấp đôi trong vòng một tháng qua, đạt giá trị định giá dựa trên dòng tiền tự do (FDV) khoảng 75 tỷ USD.

Câu hỏi đặt ra: SN3 đã làm gì? Tại sao nó lại được đưa ra ánh sáng chiếu sáng? Câu chuyện giá trị về huấn luyện phân tán và AI phi tâm trung sẽ tiếp tục phát triển như thế nào?

Mô hình 72B đó

Để trả lời câu hỏi này, trước hết phải xem xét bản báo cáo kết quả từ SN3.

Vào ngày 10 tháng 3 năm 2026, nhóm Covenant AI đã công bố một bản báo cáo kỹ thuật trên arXiv, chính thức thông báo rằng Covenant-72B đã hoàn thành quá trình huấn luyện. Đây là một mô hình ngôn ngữ lớn với 720 tỷ tham số, vượt qua 70 nút đồng thuận độc lập (mỗi vòng khoảng 20 nút đồng bộ hóa, mỗi nút được trang bị 8 chiếc B200), đã hoàn thành quá trình tiền huấn luyện của mô hình có 720 tỷ tham số trên kho dữ liệu gồm khoảng 11 nghìn tỷ token.

Templar cung cấp một số dữ liệu về kiểm tra đồng bộ, và được so sánh với LLaMA-2-70B từ Meta được công bố vào năm 2023. Như Jack Clark, người sáng lập của Anthropic, đã nói, Covenant-72B khi đặt vào năm 2026 có thể đã lỗi thời. Covenant-72B đạt 67,1 điểm trên MMLU, xấp xỉ với LLaMA-2-70B của Meta được công bố vào năm 2023 (65,6 điểm).

Và những mô hình tiên tiến vào năm 2026, bất kể là dòng GPT, Claude hay Gemini, đã hoàn thành quá trình huấn luyện với số lượng tham số vượt quá 1000 tỷ trên hàng trăm nghìn GPU, khoảng cách về khả năng suy luận, mã và toán học là một vấn đề về thứ tự độ lớn chứ không phải là về phần trăm. Sự khác biệt này trong thực tế không nên bị lấn át bởi tâm trạng thị trường.

Nhưng khi chuyển đổi sang “được huấn luyện bằng khả năng tính toán phân tán trên internet mở”, nghĩa là hoàn toàn khác biệt.

Hãy so sánh: INTELLECT-1 (sản phẩm của nhóm Prime Intellect, với 100 tỷ tham số) được đánh giá MMLU 32,7 trong quá trình huấn luyện phi trung tâm; một dự án huấn luyện phân tán khác trong danh sách trắng được gọi là Psyche Consilience (với 400 tỷ tham số) đạt 24,2 điểm. Covenant-72B với quy mô 72 tỷ tham số, đạt 67,1 điểm trên MMLU, trong cuộc đua huấn luyện phi trung tâm, là một con số đáng chú ý.

Quan trọng hơn, quá trình huấn luyện lần này là “không cần giấy phép”. Bất kỳ ai cũng có thể tham gia và trở thành một nút tham gia, không cần kiểm duyệt trước, không cần được liệt kê trong danh sách trắng. Hơn 70 nút độc lập đã tham gia cập nhật mô hình, đóng góp khả năng tính toán từ khắp nơi trên thế giới.

Những gì Huang Renxun đã nói và những gì không nói

Việc khôi phục chi tiết cuộc trò chuyện podcast sẽ giúp điều chỉnh cách mà bên ngoài hiểu về sự "ủng hộ" này.

Chamath Palihapitiya trong cuộc trò chuyện đã giới thiệu thành tựu công nghệ của Bittensor cho Huang Renxun và mô tả nó như việc sử dụng sức mạnh tính toán phân tán để huấn luyện một mô hình Llama, quá trình "hoàn toàn phân tán, đồng thời duy trì trạng thái". Phản ứng của Huang Renxun là so sánh điều này với "phiên bản hiện đại của Folding@home" và tiếp tục thảo luận về sự cần thiết của việc song song hóa mô hình mã nguồn mở và độc quyền.

Cần lưu ý rằng Huang Renxun không đề cập trực tiếp đến mã thông báo của Bittensor hoặc bất kỳ ý nghĩa đầu tư nào, cũng không tiếp tục thảo luận về việc huấn luyện AI không trung ương.

Hiểu Bittensor Subnet và SN3

Để hiểu sự đột phá của SN3, trước tiên cần hiểu logic hoạt động của Bittensor và các subnet của nó. Đơn giản, Bittensor có thể được xem như một chuỗi khối AI và nền tảng, trong đó mỗi subnet tương đương với một "dây chuyền sản xuất AI" độc lập, mỗi subnet có mục tiêu cốt lõi cụ thể, thiết kế cơ chế khích lệ, hợp tác để tạo thành hệ sinh thái AI phi trung ương.

Quá trình hoạt động của nó rõ ràng và phi trung ương: chủ sở hữu subnet xác định mục tiêu của subnet và viết mô hình khích lệ; các thợ mỏ cung cấp sức mạnh tính toán trong subnet, hoàn thành các nhiệm vụ liên quan đến AI (như suy luận, huấn luyện, lưu trữ, v.v.); các người xác minh đánh giá đóng góp của thợ mỏ và tải lên điểm đánh giá lên tầng đồng thuận của Bittensor; cuối cùng, thuật toán đồng thuận Yuma của Bittensor sẽ phân phối lợi ích tương ứng cho những người tham gia subnet dựa trên phần thưởng tích lũy của mỗi subnet.

Hiện tại, trên Bittensor có 128 subnet, bao gồm suy luận, dịch vụ AI đám mây không máy chủ, hình ảnh, gán nhãn dữ liệu, học tăng cường, lưu trữ, tính toán và nhiều loại nhiệm vụ AI khác.

Và SN3 là một trong những subnet đó. Nó không làm vỏ ứng dụng ở tầng cao, không thuê API mô hình lớn có sẵn, mà trực tiếp nhắm vào một trong những mảnh nhỏ hóa nhất, đó là việc huấn luyện trước mô hình lớn trong chuỗi AI: SN3 hy vọng sử dụng mạng lưới Bittensor để điều phối tài nguyên tính toán không đồng nhất cho việc huấn luyện phân tán, thông qua khích lệ huấn luyện phân tán mô hình lớn, chứng minh rằng không cần bộ máy tính siêu lớn tập trung đắt tiền, cũng có thể huấn luyện được mô hình cơ bản mạnh mẽ. Hấp dẫn chính ở chỗ "cân bằng quyền lực" — phá vỡ sự độc quyền tài nguyên huấn luyện tập trung, cho phép cá nhân thông thường hoặc tổ chức nhỏ cũng có thể tham gia huấn luyện mô hình lớn, đồng thời hạ chi phí huấn luyện thông qua sức mạnh tính toán phân tán.

Động lực chính đằng sau sự phát triển của SN3 là Templar, với nhóm nghiên cứu đứng sau là Covenant Labs. Nhóm này cũng đồng thời điều hành hai mạng con khác: Basilica (SN39, tập trung vào dịch vụ tính toán) và Grail (SN81, tập trung vào huấn luyện hậu RL và đánh giá mô hình). Ba mạng này hình thành một tích hợp thẳng đứng, bao gồm toàn bộ quy trình từ huấn luyện trước đến tối ưu hóa căn chỉnh của mô hình lớn, xây dựng một sinh thái hoàn chỉnh cho việc huấn luyện mô hình lớn phi tập trung.

Cụ thể, các thợ mỏ đóng góp tài nguyên tính toán bằng cách tải lên cập nhật gradient (hướng và mức độ điều chỉnh tham số mô hình) lên mạng; người xác thực đánh giá chất lượng đóng góp của từng thợ mỏ, đưa ra điểm số trên chuỗi dựa trên mức độ cải thiện sai số. Kết quả quyết định trọng số phần thưởng được tự động phân phối, không cần tin tưởng bất kỳ bên thứ ba nào.

Yếu tố quan trọng của thiết kế cơ chế khuyến khích là, phần thưởng trực tiếp liên kết với "đóng góp của bạn đã làm cho mô hình tốt hơn bao nhiêu", thay vì chỉ đơn giản là sức mạnh tính toán. Điều này mở ra cách giải quyết khó khăn nhất trong tình huống phi tập trung: làm thế nào để ngăn chặn thợ mỏ lười biếng.

Vậy Covenant-72B làm thế nào để giải quyết vấn đề hiệu suất giao tiếp và sự tương thích khích lệ?

Cho phép hàng chục nút không tin tưởng lẫn nhau, phần cứng đa dạng và chất lượng mạng không đồng đều cùng hợp tác huấn luyện một mô hình, thách thức bao gồm hai phần: một là hiệu suất giao tiếp, giải pháp huấn luyện phân tán tiêu chuẩn yêu cầu kết nối giữa các nút có băng thông cao và độ trễ thấp; hai là sự tương thích khích lệ, làm thế nào để ngăn chặn các nút độc hại gửi gradient sai lầm? Làm thế nào để đảm bảo mỗi bên tham gia đều huấn luyện trung thực, chứ không phải sao chép kết quả của người khác?

SN3 giải quyết hai vấn đề này bằng hai thành phần cốt lõi: SparseLoCo và Gauntlet.

SparseLoCo giải quyết vấn đề hiệu suất giao tiếp. Huấn luyện phân tán truyền thống yêu cầu đồng bộ gradient hoàn chỉnh ở mỗi bước, lượng dữ liệu lớn. Phương án mà SparseLoCo sử dụng là: mỗi nút chạy 30 bước tối ưu hóa cục bộ (AdamW), sau đó nén "gradient giả" sinh ra và tải lên cho các nút khác. Phương pháp nén bao gồm Sự Rải rác Top-k (chỉ giữ lại các thành phần gradient quan trọng nhất), Phản hồi Sai số (chồng phần bị loại bỏ để tích lũy cho chu kỳ tiếp theo) và 2-bits Quantization. Tỷ lệ nén cuối cùng vượt quá 146 lần.

Nói cách khác, cái mà trước đây cần truyền 100MB, bây giờ chỉ cần dưới 1MB là đủ.

Điều này giúp hệ thống duy trì tỷ lệ sử dụng tính toán khoảng 94,5% trên hạn chế băng thông Internet thông thường (tốc độ lên 110Mbps, xuống 500Mbps) - 20 nút, mỗi nút 8 card B200, mỗi chu kỳ truyền thông chỉ mất khoảng 70 giây.

Gauntlet giải quyết vấn đề tương thích về động lực. Nó chạy trên chuỗi khối Bittensor (Subnet 3), chịu trách nhiệm xác thực chất lượng gradient giả mạo mà mỗi nút gửi. Cụ thể là: Sử dụng một lượng dữ liệu nhỏ để kiểm tra "Sau khi sử dụng gradient của nút này, mất mát mô hình đã giảm đi bao nhiêu", kết quả được gọi là LossScore. Đồng thời, hệ thống cũng kiểm tra xem nút có đang huấn luyện trên dữ liệu mà nó được phân chia hay không — nếu một nút cải thiện mất mát trên dữ liệu ngẫu nhiên một cách tốt hơn so với trên dữ liệu mà nó được phân chia, nó sẽ bị trừ điểm.

Cuối cùng, mỗi vòng huấn luyện chỉ chọn lấy gradient của nút có điểm cao nhất để tham gia tổng hợp, các nút khác sẽ bị loại bỏ khỏi vòng huấn luyện này. Người tham gia dư thừa sẽ được thay thế bất cứ lúc nào, giữ cho hệ thống ổn định. Trong suốt quá trình huấn luyện, trung bình mỗi vòng có 16.9 gradient của nút được tích hợp vào tổng hợp, số lượng nút duy nhất đã tham gia đã vượt qua con số 70.

Giá trị kể chuyện của AI phi trung tâm, đang trải qua một thay đổi cấu trúc căn bản

Đánh giá vấn đề từ góc độ công nghệ và ngành, có một số ý nghĩa thực sự của Covenant-72B đại diện.

Thứ nhất, phá vỡ giả thuyết "Huấn luyện phân tán chỉ phù hợp với mô hình nhỏ". Mặc dù còn xa so với mô hình tiên tiến, nhưng đã chứng minh được tính mở rộng của hướng này.

Thứ hai, sự tham gia không cần phép là thực sự khả thi. Điều này đã bị đánh giá thấp. Các dự án huấn luyện phân tán trước đó dựa vào danh sách trắng — chỉ có những người tham gia được kiểm tra mới có thể đóng góp sức mạnh tính toán. Trong quá trình huấn luyện lần này của SN3, bất kỳ ai có đủ sức mạnh tính toán đều có thể tham gia, cơ chế xác thực giữ vai trò lọc ra những người góp phần xấu. Điều này là một bước cụ thể hướng đến "thực sự phi trung tâm".

Thứ ba, cơ chế dTAO của Bittensor làm cho việc khám phá giá trị của mạng con trở nên khả thi. dTAO cho phép mỗi mạng con phát hành mã thông minh Alpha riêng của mình, thông qua cơ chế AMM để định rõ xem mạng con nào nhận được nhiều phát tán TAO hơn. Điều này cung cấp một cơ chế bắt giữ giá trị khá tinh tế nhưng hiệu quả cho các mạng con đã tạo ra kết quả cụ thể như SN3. Tất nhiên, cơ chế này cũng dễ bị ảnh hưởng bởi câu chuyện và tâm trạng, cho nên chất lượng kết quả huấn luyện của LLM rất khó được đánh giá độc lập bởi người tham gia thị trường thông thường.

Thứ tư, ý nghĩa chính trị kinh tế của việc huấn luyện AI phi trung tâm. Jack Clark trong Import AI đã đặt vấn đề này lên "Ai sẽ sở hữu tương lai của AI" ở mức độ đó. Việc huấn luyện mô hình tiên tiến hiện đang bị một số tổ chức sở hữu trung tâm dữ liệu lớn thiêng liêng, đây không chỉ là một vấn đề kinh doanh mà còn là vấn đề cấu trúc quyền lực. Nếu huấn luyện phân tán có thể tiếp tục tiến triển công nghệ, có thể hình thành một sinh thái phát triển thực sự phi trung tâm trong một số loại mô hình nhất định (như mô hình tiên tiến nhỏ trong một số lĩnh vực cụ thể). Tất nhiên, tầm nhìn này ở thời điểm này vẫn còn xa.

Tóm Tắt: Một Mốc Thời Gian Thực Sự và Một Loạt Câu Hỏi Thực Tế

Hwang In-hyeon nói rằng đây giống như "phiên bản hiện đại của Folding@home". Folding@home đã đóng góp thực sự trong lĩnh vực mô phỏng phân tử, nhưng không đe dọa vị thế nghiên cứu cốt lõi của các công ty dược lớn. So sánh này rất chính xác.

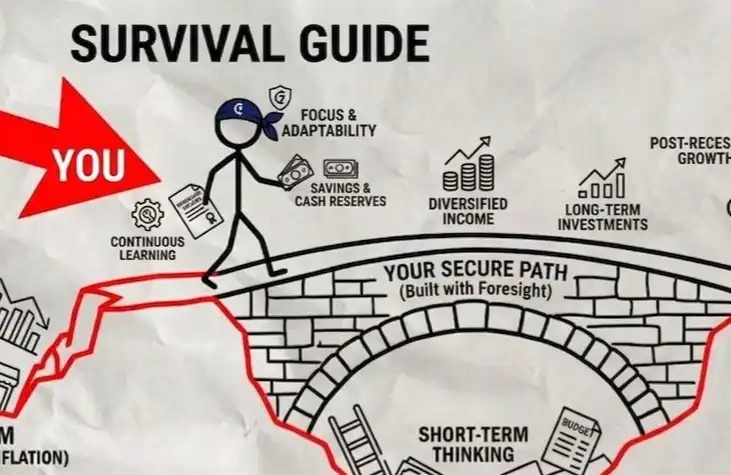

SN3 đã chạy được giao thức, đã xác minh hướng phân phối huấn luyện là khả thi. Nhưng từ cả góc độ công nghệ và ngành, đằng sau bảng điểm mà nó đã đạt được, vẫn còn một loạt vấn đề mà rất ít người muốn thảo luận một cách nghiêm túc:

Chính MMLU, một chỉ số đầy tranh cãi trong giới học thuật, mắc rủi ro của việc tiết lộ câu hỏi và đáp án của các bài kiểm tra công cộng vào tập dữ liệu huấn luyện. Đáng chú ý hơn là việc chọn lựa điểm chuẩn: so với các mô hình cũ như LLaMA-2-70B và LLM360 K2 được đề xuất trong bài báo, cả hai đều là mô hình cũ từ năm 2023 đến 2024, và vào khoảng điểm từ 65 đến 70 trong cùng một khoảng thời gian, khi đề cập đến Grok hay Jellybean, chúng đều bị xếp vào mức trung và cấp nhập môn, trong khi theo Claude, chúng thuộc loại đứng sau nhiều. Nếu đặt chúng vào bảng xếp hạng được cập nhật động hoặc trên các tiêu chuẩn mới mang thiết kế chống ô nhiễm, có lẽ kết luận sẽ trung thực hơn.

Quan trọng hơn, dữ liệu chất lượng cao quyết định ranh giới khả năng của mô hình—dữ liệu trò chuyện, mã nguồn, bằng chứng toán học, văn bản khoa học—có khả năng lớn sẽ nằm trong tay của các công ty lớn, cơ quan xuất bản và cơ sở dữ liệu học thuật. Sức mạnh tính toán đã dân chủ hóa, nhưng dữ liệu vẫn duy trì cấu trúc oligopolistic, mâu thuẫn này chưa được thảo luận.

Về mặt an ninh, việc tham gia không cần phép tức là bạn không biết đằng sau 70 nút đó là ai, cũng không biết họ đang sử dụng dữ liệu gì để huấn luyện. Gauntlet có thể lọc ra những biến dạng rõ ràng của gradient, nhưng không thể ngăn chặn nhiễm chất dữ liệu tinh tế—nếu một nút một cách có hệ thống liên tục huấn luyện nhiều vòng tròn về một dạng nội dung độc hại nào đó, sự biến đổi gradient tạo ra đủ mịn, có thể vượt qua kiểm tra điểm mất mát, nhưng tạo ra đào thải biến đổi tích lũy đối với hành vi mô hình.Vấn đề cuối cùng là: Trong các tình huống yêu cầu an toàn và tuân thủ pháp lý cao như tài chính, y tế, pháp lý, việc sử dụng một mô hình được huấn luyện bởi một số ít nút ẩn danh, nguồn dữ liệu không thể được truy vết đầy đủ, sẽ mang lại những rủi ro nào?

Ngoài ra, một vấn đề cấu trúc cũng cần phải nói thẳng: Covenant-72B chính thức được phát hành theo giấy phép Apache 2.0, không sử dụng token SN3. Việc nắm giữ token SN3 chia sẻ một phần của lợi tức phát sinh từ việc tạo ra mô hình mới liên tục trên mạng lưới con này vào tương lai, thay vì bất kỳ lợi ích trực tiếp nào khi mô hình được sử dụng. Chuỗi giá trị này phụ thuộc vào việc tạo ra liên tục từ quá trình huấn luyện, cũng như hoạt động cân đối tổng thể của cơ chế phát thải mạng lưới Bittensor. Nếu quá trình huấn luyện tương lại bị trì trệ, hoặc chất lượng của kết quả huấn luyện mới không đạt mong đợi, lý thuyết định giá token sẽ trở nên không ổn định.

Liệt kê những vấn đề này không phải để phủ nhận ý nghĩa của Covenant-72B. Nó chứng minh một điều trước đây được coi là không thể có thể thực hiện, sự thật này sẽ không bao giờ biến mất. Nhưng việc thực hiện điều đó và ý nghĩa của nó là hai vấn đề khác nhau.

Token SN3 đã tăng 440% trong vòng một tháng qua. Khoảng cách này có thể không chỉ là sự tăng giá rõ ràng, mà còn là tốc độ câu chuyện luôn nhanh hơn tốc độ thực tế. Việc khoảng cách này sẽ cuối cùng được điền vào bởi hiện thực, hay sẽ được điều chỉnh và tiêu hóa bởi thị trường, phụ thuộc vào việc đội ngũ Covenant AI thực sự mang lại điều gì tiếp theo.

Đáng chú ý là, vào tháng 1 năm 2026, Grayscale đã nộp đơn xin ETF TAO, đánh dấu tín hiệu cho vốn bản địa gia nhập con đường này. Hơn nữa, vào tháng 12 năm 2025, Bittensor sẽ giảm nửa lượng TAO phát ra hàng ngày, việc siết chặt cung cấp vẫn đang được xem xét.

Chào mừng bạn tham gia cộng đồng chính thức của BlockBeats:

Nhóm Telegram đăng ký: https://t.me/theblockbeats

Nhóm Telegram thảo luận: https://t.me/BlockBeats_App

Tài khoản Twitter chính thức: https://twitter.com/BlockBeatsAsia