Sau 48 giờ bị cấm, Claude leo lên vị trí số một trên App Store

Vào sáng thứ Bảy, Ultraman đã chia sẻ một bức ảnh chụp màn hình của một email nội bộ trên X.

Email đó là email mà anh ấy đã viết vào đêm thứ Năm cho nhân viên của OpenAI, nói rằng công ty đang tiến hành các cuộc trò chuyện với Bộ Tổng hợp Hoa Kỳ, và anh ấy hy vọng có thể giúp đỡ để "làm dịu tình hình". Anh ấy chia sẻ email đó kèm theo vài dòng giải thích, ý chính là muốn công khai giải thích những gì đã xảy ra trong vài ngày qua.

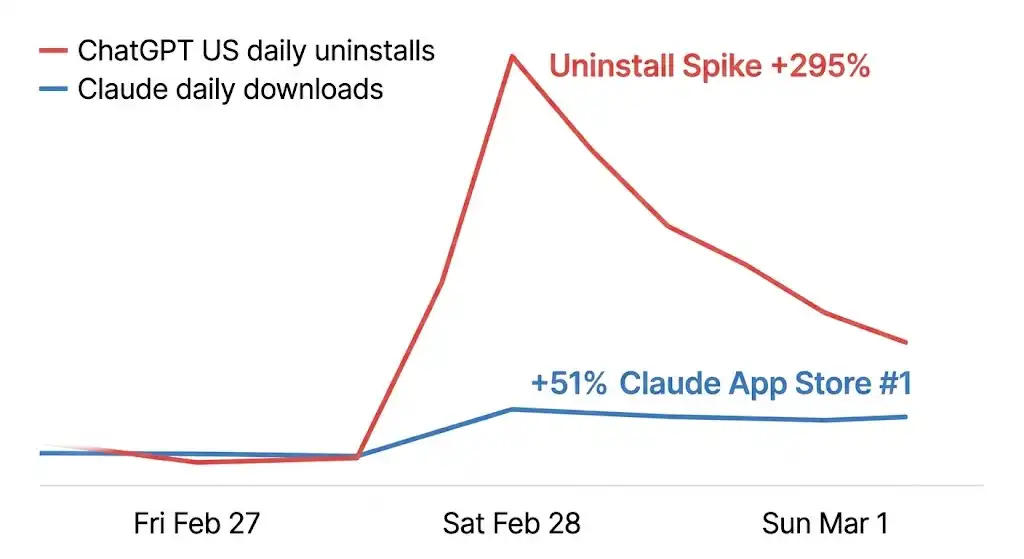

Khi anh ấy đăng tweet đó, Claude đã leo lên vị trí số một trên bảng xếp hạng miễn phí của App Store Hoa Kỳ. Ngay vào ngày trước đó, ChatGPT vẫn đang giữ vị trí đó.

Dữ liệu từ Sensor Tower ghi nhận những gì đã xảy ra trong vài giờ tiếp theo: vào Chủ Nhật, số lượt gỡ cài đặt của ChatGPT tại Hoa Kỳ tăng đột ngột lên đến 295% so với ngày thường, số lượng đánh giá một sao tăng lên 775%. Cùng lúc đó, lượt tải về của Claude tăng lên 51% trong một ngày. Trên Reddit, cơn sóng "Huỷ bỏ ChatGPT" bắt đầu nổi lên, người dùng chia sẻ ảnh chụp màn hình hủy đăng ký, một số người viết trong phần bình luận: "cài đặt nhanh nhất trong đời". Một trang web mang tên QuitGPT.org đã ra mắt, tuyên bố rằng 1,5 triệu người đã tham gia hành động này.

Vào ngày thứ Hai, số lượng người dùng truy cập vào quá nhiều, Claude đã gặp sự cố với quy mô lớn. Công ty có tên trong danh sách "Rủi ro an ninh chuỗi cung ứng" của chính phủ liên bang, và do sự tăng trưởng lớn về số lượng người dùng, máy chủ đã không chịu nổi áp lực.

Phản công sản phẩm chính xác

Vào cùng một ngày khi làn sóng gỡ cài đặt đang nổi lên, Anthropic đã ra mắt công cụ di dời ký ức.

Chức năng của công cụ không phức tạp. Người dùng sao chép một đoạn từ khóa gợi ý vào ChatGPT để nó xuất ra tất cả ký ức và sở thích đã lưu trữ, sau đó dán vào Claude, Claude chỉ cần nhấn một nút để nhập, và tiếp tục từ nơi bạn đã rời khỏi ChatGPT. Một câu quảng cáo trên trang chủ chỉ có một câu: "chuyển sang Claude mà không cần bắt đầu lại từ đầu".

Công cụ này, thời điểm ra mắt của nó, là tính chất quan trọng nhất.

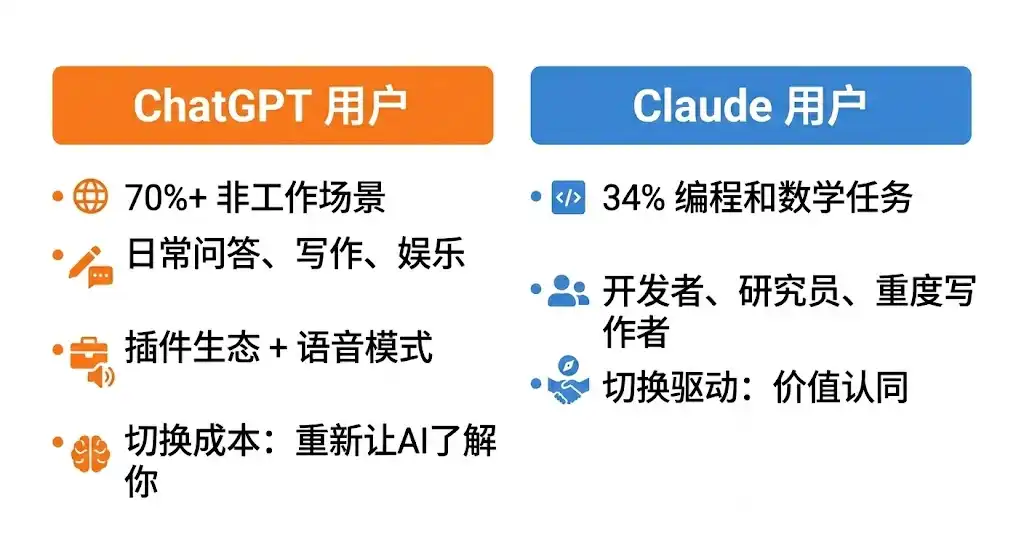

Dữ liệu từ OpenAI cho thấy, đến năm 2025, hơn 70% người dùng ChatGPT sử dụng ở các tình huống không liên quan đến công việc, như câu hỏi hàng ngày, viết lách, giải trí và tìm kiếm thông tin. Nó là trí tuệ nhân tạo đầu tiên mà nhiều người tiếp xúc, dựa vào hệ sinh thái phong phú của các plug-in, Chế Độ Giọng Nói và sự tích hợp sâu của các ứng dụng bên thứ ba nhúng vào cuộc sống hàng ngày. Chi phí chuyển đổi của những người dùng này không chỉ là "tải xuống một ứng dụng mới", mà là phải làm cho một trí tuệ nhân tạo không hiểu bạn là ai bắt đầu từ đầu. Thu thập ký ức, trước đây là lý do mạnh mẽ nhất để làm như vậy.

Anthropic's own research data shows that Claude's usage scenarios are highly concentrated. Programming and mathematical tasks account for 34%, the single largest category, while education and research saw the fastest growth in the past year. The core users are developers, researchers, and heavy writers, who are more rational and more likely to switch tools based on a clear value judgment, as long as the migration cost is low enough.

The memory migration tool has minimized this cost. At the same time, Anthropic has announced that the memory feature will be fully open to free users, a feature that was previously exclusive to paid users.

However, a significant portion of these new users are not the original target users of Claude.

From the feedback on social media, a large number of ordinary users migrating from ChatGPT to Claude often react with "It's different" upon their first use of Claude. Some people feel that Claude's responses have more depth and will push back actively, rather than just agreeing to everything. Some people find it cleaner in writing, but it does not generate images and does not have the interactive experience like Voice Mode.

Some originally wanted to find a "more obedient ChatGPT alternative" but discovered that Claude has a stronger personality, requiring adaptation over time. A migration guide from TechRadar has been widely shared in the past two days, with the title "I wish someone had told me these things," and the core message of the article is: Claude's logic of use is fundamentally different from ChatGPT; the former is more like a opinionated working partner, while the latter is more like a versatile assistant.

This difference was originally the positioning of the two products, but it was inadvertently magnified by this event. Users flocked to Claude due to ethical stances, only to discover a product that was different from their expectations, a more discerning, boundary-aware AI. This difference could have been a reason for churn, but at this particular moment, it has become a reason to stay: when you believe in a company's stance, you are more likely to accept the logic of its product.

Several days after its release, Anthropic released data: free active users grew by over 60% compared to January, and daily new registrations quadrupled. Due to high traffic, Claude once crashed due to excessive visits, with thousands of users reporting login issues, which were resolved within a few hours.

Three Words in the Contract: What OpenAI Said and Did

Anthropic is the first company to deploy an AI model on the U.S. military's classified network, a collaboration completed through Palantir, with the contract valued at about $200 million. However, over the past few months, the relationship between the two parties has continued to deteriorate. The core of the dispute is a clause: the Pentagon requires the AI model to be open for "all lawful purposes," without any conditions. Anthropic insists on two exceptions: the AI model cannot be used for large-scale surveillance of U.S. citizens and cannot be used for fully autonomous weapon systems.

Vào ngày 20 tháng 2, một giám đốc cấp cao của Anthropic đã bày tỏ về cách Claude được sử dụng trong hoạt động bắt giữ tổng thống Venezuela Maduro của quân đội Mỹ trong tháng 1 và đã đề nghị Palantir đối tác một số câu hỏi, quân đội không hài lòng với điều này. Vào thứ Năm, Bộ Tư lệnh đã đưa ra lời đe dọa cuối cùng, yêu cầu Dario Amodei đưa ra câu trả lời trước 5 giờ chiều cùng ngày.

Amodei đã phát biểu trước thời hạn, cho biết công ty không thể chấp nhận các điều khoản hiện tại vì "không phải vì chúng tôi phản đối việc sử dụng quân sự, mà vì trong một số trường hợp, chúng tôi tin rằng trí tuệ nhân tạo có thể gây tổn hại chứ không phải bảo vệ các giá trị dân chủ". Ngay sau đó, Trump tuyên bố rằng các cơ quan liên bang sẽ ngừng sử dụng sản phẩm của Anthropic hoàn toàn trong vòng sáu tháng, Hegseth xếp nó vào danh sách "Rủi ro an ninh chuỗi cung ứng", nhãn này thường được sử dụng cho các công ty đối thủ nước ngoài. Hợp đồng đã kết thúc ở đây.

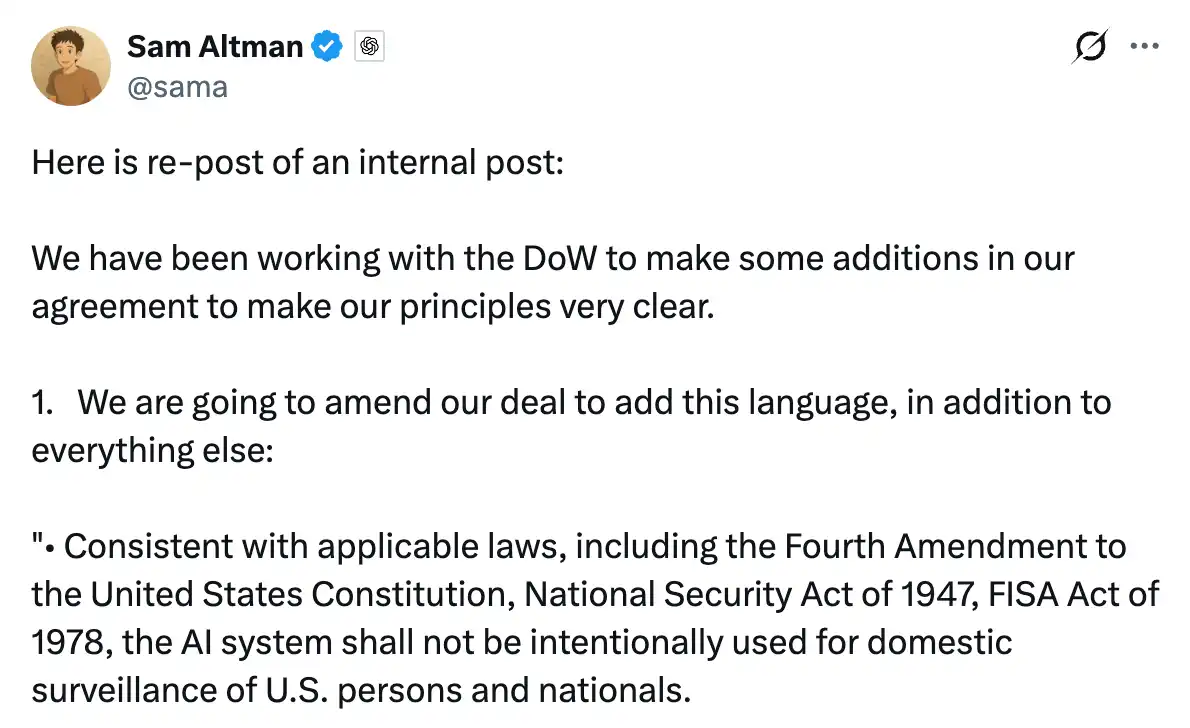

Vị trí trống trơn sau đó đã nhanh chóng được lấp đầy. Vào cùng một ngày sau đó, OpenAI đã công bố đã ký hợp đồng với Bộ Tư lệnh. Trong bức thư nội bộ vào thứ Năm, ông Altman khẳng định rằng, quan điểm vẫn rõ ràng, ông viết rằng đây đã trở thành "vấn đề của toàn bộ ngành", nói rằng OpenAI và Anthropic giữ cùng một "đường ranh giới không vượt quá": phản đối giám sát quy mô lớn, phản đối vũ khí tự hành. Vào thứ Sáu, thỏa thuận đã được đạt được, sẽ triển khai mô hình trên mạng lưới bí mật của quân đội, giới hạn chỉ có thể chạy trên đám mây, cử nhân viên kỹ sư giám sát, và cho biết các hạn chế giống nhau đã được viết trong hợp đồng.

Sau đó, Altman đã tổ chức một phiên hỏi đáp mở trên X, trả lời trong vài giờ. Một người hỏi ông: Tại sao Bộ Tư lệnh chấp nhận OpenAI, nhưng cấm Anthropic? Câu trả lời của ông là: "Dường như Anthropic tập trung hơn vào các điều khoản cụ thể trong hợp đồng, thay vì trích dẫn pháp luật tương ứng, trong khi chúng tôi hài lòng với việc trích dẫn pháp luật".

Câu này nói về sự khác biệt trong phương pháp luận, nhưng nó đã mở ra mâu thuẫn thực sự của vấn đề này.

Khóa giải cho việc thảo luận hỏng với Anthropic, là điều mà Bộ Tư lệnh mạnh mẽ lưu ý trong mệnh đề họ viết: Hệ thống trí tuệ nhân tạo có thể được sử dụng cho "tất cả các mục đích hợp pháp", tức là tất cả các mục đích hợp pháp. Lý do mà Anthropic từ chối là, cụm từ này không phải là ranh giới cố định trong ngữ cảnh an ninh quốc gia. Luật hiện hành vẫn chưa kịp theo kịp khả năng của trí tuệ nhân tạo ở nhiều mặt, phạm vi "hợp pháp" sẽ được quyết định bởi diễn giải của chính phủ. OpenAI đã ký chữ này, đồng thời tuyên bố rằng các biện pháp bảo vệ tương tự đã được viết vào trong hợp đồng.

Sau đó, các chuyên gia pháp lý đã phân tích các điều khoản hợp đồng mà OpenAI đã công khai, chỉ ra hai vấn đề cụ thể trong diễn đàn.

Điều khoản giám sát nêu rõ rằng hệ thống không được sử dụng để giám sát thông tin cá nhân của công dân Mỹ một cách "không bị ràng buộc". Phó Chủ tịch Chính sách của Trung tâm Dân chủ và Công nghệ, Samir Jain, chỉ ra rằng cụm từ ở đây ám chỉ rằng phiên bản giám sát "bị ràng buộc" là được chấp nhận. Và trong bối cảnh pháp lý hiện tại, chính phủ hoàn toàn có thể hợp pháp mua bản ghi vị trí, lịch sử duyệt web và dữ liệu tài chính của công dân từ các nhà môi giới dữ liệu để cho trí tuệ nhân tạo phân tích dữ liệu này, mà từ mặt kỹ thuật không được coi là "giám sát bất hợp pháp". Amodei đã đưa ra ví dụ này trong cuộc phỏng vấn với CBS sau đó.

Điều khoản về vũ khí nêu rõ rằng hệ thống không được sử dụng cho vũ khí tự hành trong "trường hợp yêu cầu kiểm soát bởi con người theo pháp luật, quy định hoặc chính sách của bộ phận". Cụm từ này ám chỉ rằng, hạn chế chỉ có hiệu lực khi các quy định khác đã yêu cầu kiểm soát bởi con người, và sự ràng buộc hoàn toàn được dựa trên chính sách hiện có. Và Bộ Tư lệnh Cục Phòng không có quyền sửa đổi chính sách nội bộ của mình bất cứ lúc nào. Luật sư Charles Bullock viết trên X rằng điều khoản về vũ khí trong hợp đồng phụ thuộc vào Hướng dẫn DoD 3000.09, hướng dẫn này yêu cầu chỉ huy giữ lại "sự đánh giá của con người ở mức độ phù hợp", và mức độ "phù hợp" này là một tiêu chuẩn có thể linh hoạt.

OpenAI đã đối mặt với các thắc mắc này bằng cách nói rằng: mô hình chỉ có thể chạy trên điện toán đám mây, điều này từ cấu trúc đã loại trừ khả năng tích hợp trực tiếp vào hệ thống vũ khí. Hợp đồng cũng chỉ ra cơ sở pháp lý cụ thể, mạnh mẽ hơn so với cụm từ cấm việc sử dụng, bởi vì pháp luật là một khung xác minh. Ngay cả chính bản thân Amodei cũng thừa nhận trong cuộc hỏi đáp rằng: "Nếu sau này chúng ta cần phải chiến đấu, chúng ta sẽ chiến đấu, nhưng điều này rõ ràng đưa chúng ta đối diện với một số rủi ro."

Điều này không phải là vấn đề giữa một công ty sẵn lòng thỏa hiệp và một công ty kiên trì với nguyên tắc, mà đây là sự khác biệt giữa hai triết lý an ninh hoàn toàn khác biệt. Đường ranh giới của OpenAI là: Tôi không làm những việc bất hợp pháp. Đường ranh giới của Anthropic là: Pháp luật chưa cấm, nhưng tôi cho rằng không nên làm việc đó, tôi cũng không làm.

Sự khác biệt này đã tạo ra rạn nứt trong cả OpenAI. Tuần trước, nhiều nhân viên của OpenAI đã ký thư ngỏ công khai, ủng hộ quan điểm của Anthropic, phản đối việc xem nó là một rủi ro chuỗi cung ứng. Nhà nghiên cứu tại OpenAI, Leo Gao, đã công khai đặt câu hỏi về việc liệu hợp đồng công ty có cung cấp đủ bảo vệ hay không. Trên con đường ở ngoài văn phòng của OpenAI tại San Francisco, xuất hiện những lời phê phán được viết bằng phấn. Trong khi ngoài văn phòng của Anthropic thì lại có những lời nhắn hỗ trợ. Cuộc hỏi đáp kéo dài hàng giờ của Amodei đó, phần lớn dành cho những người đang ở phía của công ty mình từng ủng hộ Anthropic.

Kết quả của cùng một câu chuyện

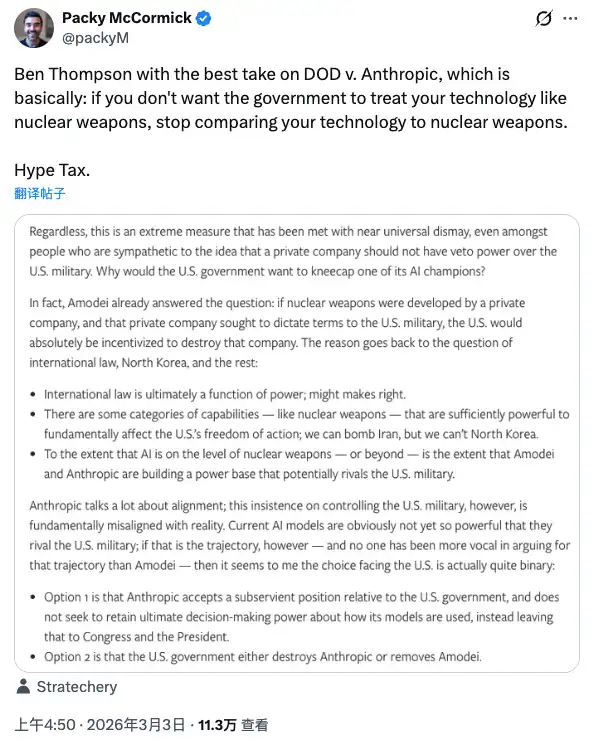

Suốt nhiều năm, Anthropic luôn dùng "ngăn ngừa rủi ro cấp độ văn minh" để bố cục nhiệm vụ an ninh của mình, đặt mối đe dọa tiềm ẩn từ trí tuệ nhân tạo vào một tầm bằng với vũ khí hạt nhân, định vị bản thân như một người gác cổng trên đường phòng thủ đó. Câu chuyện này là cốt lõi của thương hiệu của họ, cũng là cách họ thu hút lòng tin trên thị trường vốn.

Trong thời kỳ sôi nổi này, nhà bình luận công nghệ Packy McCormick đã trích dẫn một khái niệm của Ben Thompson: Thuế Hype. Ý nghĩa là, nếu bạn xây dựng sức ảnh hưởng của mình bằng cách sử dụng phê phán cực đoan, khi câu chuyện này đối mặt với quyền lực thực sự, bạn sẽ phải trả giá cho nó. Bạn so sánh công nghệ AI với vũ khí hạt nhân, chính phủ sẽ đối xử với bạn như với một vũ khí hạt nhân.

Anthropic đã trả giá cho câu chuyện này: mất một hợp đồng, được xem là mối nguy hiểm an ninh, bị tổng thống đặt tên, tất cả các sản phẩm của họ được yêu cầu loại bỏ khỏi hệ thống liên bang trong vòng sáu tháng.

Nhưng trong cùng một cuối tuần, cùng một câu chuyện đã tạo ra hiệu ứng hoàn toàn ngược lại ở một chiều khác.

Người dùng thông thường không nhìn thấy điều khoản hợp đồng, không phải là giải thích pháp lý, không phải là cuộc tranh luận về triết lý an ninh. Họ nhìn thấy: một công ty từ chối, bị chính phủ đuổi ra khỏi, công ty khác đồng ý, nhận được hợp đồng. Họ đã đưa ra quyết định dựa trên khung nhìn riêng của mình, 295% lượt gỡ cài đặt, số một trên App Store, máy chủ bị sụp đổ.

Điều này là một phản ứng đạo đức tập thể hiếm có trong lịch sử ngành công nghệ AI.

Anthropic không tiêu bất kỳ khoản ngân sách PR nào vào vấn đề này. Tuyên bố của Amodei ôn hòa, không kêu gọi sự ủng hộ của người dùng, không đề cập đến OpenAI, không tự xây dựng hình ảnh mình thành một kẻ tử vong. Nhưng kết quả đã xảy ra.

Có một chi tiết đáng chú ý ở đây: sự kiện khiến người dùng chuyển hướng đến Claude, về cơ bản là OpenAI đã thực hiện một hành động hoàn toàn hợp lý trong kinh doanh, ký kết hợp đồng khi đối thủ bị cấm, hợp đồng treo. và tuyên bố rằng họ đã thảo luận về cùng những điều khoản bảo vệ. Ultraman cũng rõ ràng cho biết, việc làm của anh ấy một phần là để giúp làm dịu tình hình, ngăn chặn thêm tổn thương cho Anthropic.

Dù động cơ có thế nào, kết quả là OpenAI đã nhận được hợp đồng, người dùng của Anthropic đã tăng. Cả hai bên đều phải trả giá, cả hai bên đều có lợi ích, chỉ là đơn vị đo khác nhau.

Còn một điều đáng chú ý ở đây.

Hợp đồng Pentagon trị giá khoảng 200 triệu USD mà Anthropic đã mất.

Doanh thu hàng năm hiện tại của Anthropic là 140 tỷ USD. Mục tiêu là đạt 260 tỷ USD vào năm 2026.

Tháng trước, Anthropic vừa hoàn thành vòng tài trợ E trị giá 300 tỷ USD, ước tính giá trị công ty là 3800 tỷ USD.

Việc này không khó để tính toán. Tuy nhiên, vẫn còn một vấn đề khác chưa có câu trả lời: Khi trí tuệ nhân tạo thực sự được sử dụng quy mô lớn trong quyết định quân sự, những "rào cản công nghệ" và kỹ sư triển khai được ghi trong hợp đồng liệu có thực sự hiệu quả, cho dù là của OpenAI hay những rào cản mà Anthropic ban đầu yêu cầu.

Vấn đề này không được đề cập trong bất kỳ hợp đồng nào đã được công khai.

Chào mừng bạn tham gia cộng đồng chính thức của BlockBeats:

Nhóm Telegram đăng ký: https://t.me/theblockbeats

Nhóm Telegram thảo luận: https://t.me/BlockBeats_App

Tài khoản Twitter chính thức: https://twitter.com/BlockBeatsAsia